En la era de IA: impulsando el crecimiento en el mercado de transceptores ópticos

El advenimiento de la inteligencia artificial (IA) ha sido un catalizador de cambios transformadores en diversas industrias. Uno de los dominios que está experimentando un cambio de paradigma es el mercado de transceptores ópticos. Este artículo profundiza en el impacto de la IA, particularmente en la ola de IA desencadenada por modelos como ChatGPT, en la reconfiguración de las redes de centros de datos y en el impulso del crecimiento de los transceptores ópticos de alto rendimiento, centrándose en el aumento anticipado de los transceptores ópticos de 800G en 2024.

La ola de IA provocada por ChatGPT

El desarrollo y la implementación de modelos de IA como ChatGPT han inaugurado una nueva era de posibilidades. Estos modelos, impulsados por técnicas avanzadas de aprendizaje profundo, muestran la capacidad de comprender y generar texto similar al humano. ChatGPT, como representante de esta ola de IA, ha demostrado el potencial para mejorar la comunicación y optimizar el procesamiento de datos. Sus capacidades de procesamiento del lenguaje natural contribuyen a interacciones humano-máquina más eficientes, convirtiéndose en un activo invaluable para optimizar las operaciones de los centros de datos. Por tanto, la ola de IA se ha convertido en una fuerza impulsora detrás de la necesidad de transceptores ópticos más rápidos, confiables y de mayor capacidad.

La operación de ChatGPT requiere recursos sólidos de computación en la nube para el soporte. El modelo GPT lanzado por OpenAI en 2018 tenía 117 millones de parámetros y se entrenó con aproximadamente 5GB de datos pre-entrenados. En contraste, GPT-3 cuenta con asombrosos 175 mil millones de parámetros y fue entrenado con 45TB de datos. Durante la fase de entrenamiento del modelo solo, ChatGPT consumió aproximadamente 3640 días de cómputo de PF, con costos de entrenamiento que alcanzaron los asombrosos $12 millones. El consumo durante la fase de acceso al servicio es aún mayor. Se estima que para cubrir las necesidades de búsqueda y acceso de los usuarios actuales de ChatGPT, se requiere una inversión inicial de alrededor de $3-4 mil millones en infraestructura informática, específicamente mediante servidores (GPU).

Cómo la IA remodela las redes de centros de datos

La integración de la IA en los centros de datos ha redefinido el panorama de la transmisión de datos. Los centros de datos tradicionales, diseñados para cargas de trabajo de computación convencionales, están experimentando una metamorfosis para satisfacer las demandas de aplicaciones impulsadas por la IA. El diferenciador clave radica en la forma en que se procesan y transmiten los datos.

Centro de datos tradicional vs. centro de datos de IA

En un centro de datos tradicional, los datos fluyen a través de una arquitectura de red jerárquica, donde cada capa introduce latencia y posibles cuellos de botella. Inicialmente, los centros de datos adoptaron el modelo tradicional de tres capas, que comprende la capa de acceso, la capa de agregación y la capa central. La capa de acceso conectaba nodos de cómputo a interruptores de gabinete, la capa de agregación facilitaba las interconexiones entre las capas de acceso, y la capa central gestionaba las conexiones entre las capas de agregación y las redes externas.

Sin embargo, a medida que el volumen del tráfico este-oeste dentro de los centros de datos aumentaba rápidamente, las capas de agregación y núcleo de la arquitectura de red de tres capas enfrentaban tareas crecientes y mayores requisitos de rendimiento, lo que resultaba en costos de equipos considerablemente elevados. Como consecuencia, surgió una arquitectura de red leaf-spine más simplificada y diseñada para el tráfico este-oeste. En esta arquitectura revisada, los switches leaf establecen conexiones directas con los nodos de cómputo, mientras que los switches spine funcionan como switches de núcleo, seleccionando dinámicamente múltiples rutas a través de multipath de igual costo (ECMP, por sus siglas en inglés).

La arquitectura de red leaf-spine ofrece varias ventajas, incluyendo una alta utilización del ancho de banda, excelente escalabilidad, latencia de red predecible y una seguridad mejorada. Estas características la hacen ampliamente aplicable y ventajosa para implementarla en diversos escenarios de centros de datos.

Los centros de datos de inteligencia artificial, por otro lado, aprovechan el procesamiento paralelo, la computación distribuida y las interconexiones de alta velocidad para garantizar un flujo de datos sin interrupciones y una latencia mínima. La necesidad de una arquitectura de red en árbol gordo sin bloqueos se ha vuelto crucial debido al considerable tráfico de datos interno. Los centros de datos de inteligencia artificial de NVIDIA emplean una arquitectura de red en árbol gordo para asegurar una funcionalidad sin bloqueos.

La idea fundamental detrás de esto implica utilizar una gran cantidad de switches de baja capacidad para construir una extensa red sin bloqueos. Este diseño asegura que, para cualquier patrón de comunicación, existan rutas que permitan que el ancho de banda de la comunicación coincida con el de las tarjetas de interfaz de red (NICs), y todos los switches dentro de la arquitectura sean idénticos. La arquitectura de red en árbol gordo encuentra una aplicación extendida en centros de datos con requisitos de red exigentes, especialmente en centros de cómputo de alto rendimiento y centros de datos de inteligencia artificial.

Tomemos como ejemplo el sistema de centro de datos de inteligencia artificial DGX A100 SuperPOD de NVIDIA: todos los switches de tres capas consisten en switches NVIDIA Quantum QM8790 de 40 puertos. Los switches de primera capa están conectados a 1120 NICs Mellanox HDR 200G InfiniBand. En esta configuración, los puertos de enlace descendente de los switches de segunda capa se conectan a los switches de primer nivel, mientras que sus puertos de enlace ascendente se conectan a los switches de tercer nivel. Los switches de tercera capa exclusivamente presentan puertos de enlace descendente y están interconectados con los switches de segunda capa.

Además, el lado de almacenamiento del sistema utiliza una arquitectura de red distinta, mantenida separada del lado de cómputo. Esta segregación requiere un número específico de switches y transceptores ópticos. Por lo tanto, en comparación con los centros de datos convencionales, la cantidad de switches y transceptores ópticos en los centros de datos de inteligencia artificial ha experimentado un aumento sustancial.

Los transceptores ópticos 800G desempeñan un papel fundamental

Los transceptores ópticos 800G desempeñan un papel fundamental en esta transformación. Un solo transceptor óptico 800G en el puerto óptico puede reemplazar dos transceptores ópticos 400G. Además, en el puerto eléctrico, se pueden integrar 8 canales SerDes, alineándose con los 8 canales de 100G en el puerto óptico. Este diseño conduce a una mayor densidad de canales en los switches, acompañada de una notable reducción en el tamaño físico.

La tasa del transceptor óptico está influenciada por las tarjetas de red, y la velocidad de la tarjeta de red está limitada por la velocidad del canal PCIe. En los servidores A100 DGX de NVIDIA, las conexiones internas se realizan a través de NVLink3 con un ancho de banda unidireccional de 300GB/s. Sin embargo, las GPUs A100 se conectan a las tarjetas de red ConnectX-6 a través de 16 canales PCIe 4.0, lo que da un ancho de banda total de aproximadamente 200G. En consecuencia, se necesita un transceptor óptico o cable DAC 200G para igualar el ancho de banda de 200G de la tarjeta de red.

En el caso de los servidores H100 DGX, las conexiones internas utilizan NVLink4 con un ancho de banda unidireccional de 450GB/s. Las GPUs H100 se conectan a las tarjetas de red ConnectX-7 a través de 16 canales PCIe 5.0, lo que resulta en un ancho de banda total de alrededor de 400G para una tarjeta de red individual. Es importante destacar que la velocidad del transceptor óptico está influenciada por el ancho de banda PCIe entre la tarjeta de red y la GPU.

Si la velocidad interna del canal PCIe en los servidores A100 y H100 DGX alcanzara los 800G (PCIe 6.0), sería factible desplegar tarjetas de red con un ancho de banda de 800G y emplear transceptores ópticos de 800G. Este avance tiene el potencial de mejorar significativamente la eficiencia computacional del sistema.

2024 — El año de los transceptores ópticos 800G

Mirando hacia el futuro, el 2024 se perfila como un año significativo para el mercado de transceptores ópticos, con el foco puesto en las soluciones de 800G. A partir de 2019, marcado como el punto de transición a los transceptores ópticos 100G, el mercado presentó dos caminos de actualización: 200G y 400G. Sin embargo, la próxima generación de transceptores ópticos de alta velocidad en el mercado está exclusivamente orientada hacia los transceptores ópticos 800G. Combinado con el aumento de la potencia computacional y la competencia impulsada por la IA y las redes GC (Convolucionales Generalizadas), se anticipa que importantes proveedores de servicios en la nube y gigantes tecnológicos en América del Norte realizarán adquisiciones significativas de transceptores ópticos 800G en 2024.

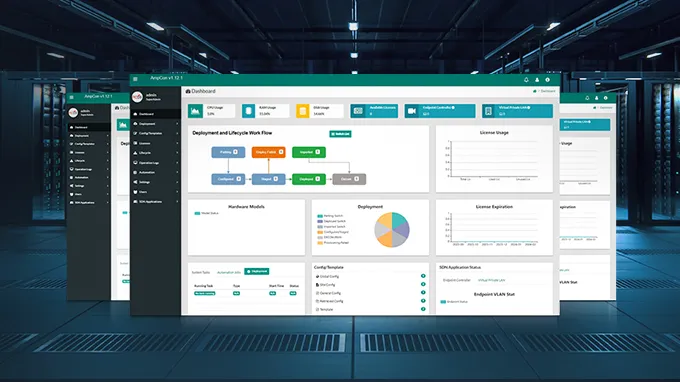

En medio de este panorama transformador, contar con un socio confiable e innovador se vuelve crucial. FS, como proveedor confiable de soluciones de redes, ofrece un completo portafolio de 800G diseñado para los centros de datos en la nube de ultra gran escala en todo el mundo. En 2023, presentamos una nueva serie de soluciones 800G NDR InfiniBand. Nuestra gama de productos abarca tanto los tipos de transceptores ópticos 800G OSFP como 800G QSFP-DD. Además, FS amplía su línea de productos para incluir AOCs y DACs 800G, lo que ayuda a ampliar nuestro apoyo a clientes de diversas industrias, asegurando un suministro continuo de productos y soluciones de redes ópticas confiables y de alta calidad.

En conclusión, la confluencia de los avances en IA y el mercado de transceptores ópticos anuncia una nueva era de transmisión de datos eficiente y de alta velocidad. El impacto transformador de la IA en las redes de centros de datos subraya el papel fundamental de los transceptores ópticos. Mientras anticipamos el año 2024, el año de los transceptores ópticos 800G, las empresas siempre pueden confiar en FS para navegar por las complejidades de la era de la IA y construir redes resilientes y de alto rendimiento que allanen el camino hacia un futuro de posibilidades ilimitadas.

También podría interesarte

Dirección de correo electrónico

-

T568A y T568B: dos estándares de cable de red RJ45

jul 15, 2021

-

¿Qué es un patch panel y por qué lo necesitamos?

jul 6, 2021